A/B Testing Bureau

A/B testen met statistische rigeur, niet op gevoel.

We berekenen de steekproefgrootte vóór de start en gluren niet halverwege naar de resultaten. De meeste bureaus doen geen van beide.

- Pre-launch sample size + duur berekend

- Geen mid-test peeking, geen valse winners

- Server-side varianten in Liquid of React PRs

Vertrouwd door ambitieuze merken wereldwijd

SEMrush agency

Uitgeroepen tot #1 SEO-bureau van Nederland door SEMrush

100% Toegewijd aan SEO

SEO is alles wat we doen, en daar zijn we goed in

De meeste bureaus roepen winnaars op basis van 50 bezoekers.En vragen zich vervolgens af waarom de lift nooit in de omzet opduikt.Wij weigeren dat.

De meeste bureaus roepen winnaars op basis van 50 bezoekers. En vragen zich vervolgens af waarom de lift nooit in de omzet opduikt. Wij weigeren dat.

Een A/B test verdient pas die naam als de steekproefgrootte, het looptijdvenster, de succesmetric en de segment-cuts vooraf zijn vastgelegd voordat de test live gaat. Wij draaien testprogrammas voor ecommerce, B2B SaaS en lead-gen sites waar elk experiment een eenpagina testplan heeft dat voor de start wordt afgetekend. Het branchegemiddelde winrate is 1 op 8. Alles wat daar materieel boven zit is gluren, p-hacking, of beide.

Bekijk onze hypothesis libraryHoe een a/b testing traject loopt

Hoe een LASEO ab testing programma loopt

Vijf onderscheidende fases per test, herhaald in een doorlopende kwartaal-backlog. Elke test begint met een eenpagina testplan dat door je team is afgetekend en eindigt met een winnaar-PR of een gedocumenteerde verliezer in de hypothesis library.

- 01

Hypothesis library + impact-to-effort scoring

We onderhouden een gedeelde Notion hypothesis library per klant. Elke voorgestelde test wordt gescoord op impact (voorspelde lift in %), effort (engineering uren) en confidence (bewijs uit analytics, gebruikersonderzoek of concurrent-patronen). Per kwartaal promoveren de hoogst scorende 8 tot 12 hypothesen naar de actieve backlog. De library is doorzoekbaar over alle eerdere tests, dus je test nooit hetzelfde idee opnieuw.

- 02

Steekproef + looptijd vooraf berekenen

Voor elke gepromote hypothese draaien we de Optimizely of VWO steekproef-calculator. Input: baseline conversie-ratio uit GA4, doel-MDE, 95% betrouwbaarheid, 80% power. Output: vereiste bezoekers per variant en het looptijdvenster. Als de pagina niet genoeg verkeer krijgt om de steekproef binnen 6 weken te halen, wordt de test verworpen of verplaatst naar een drukker oppervlak.

- 03

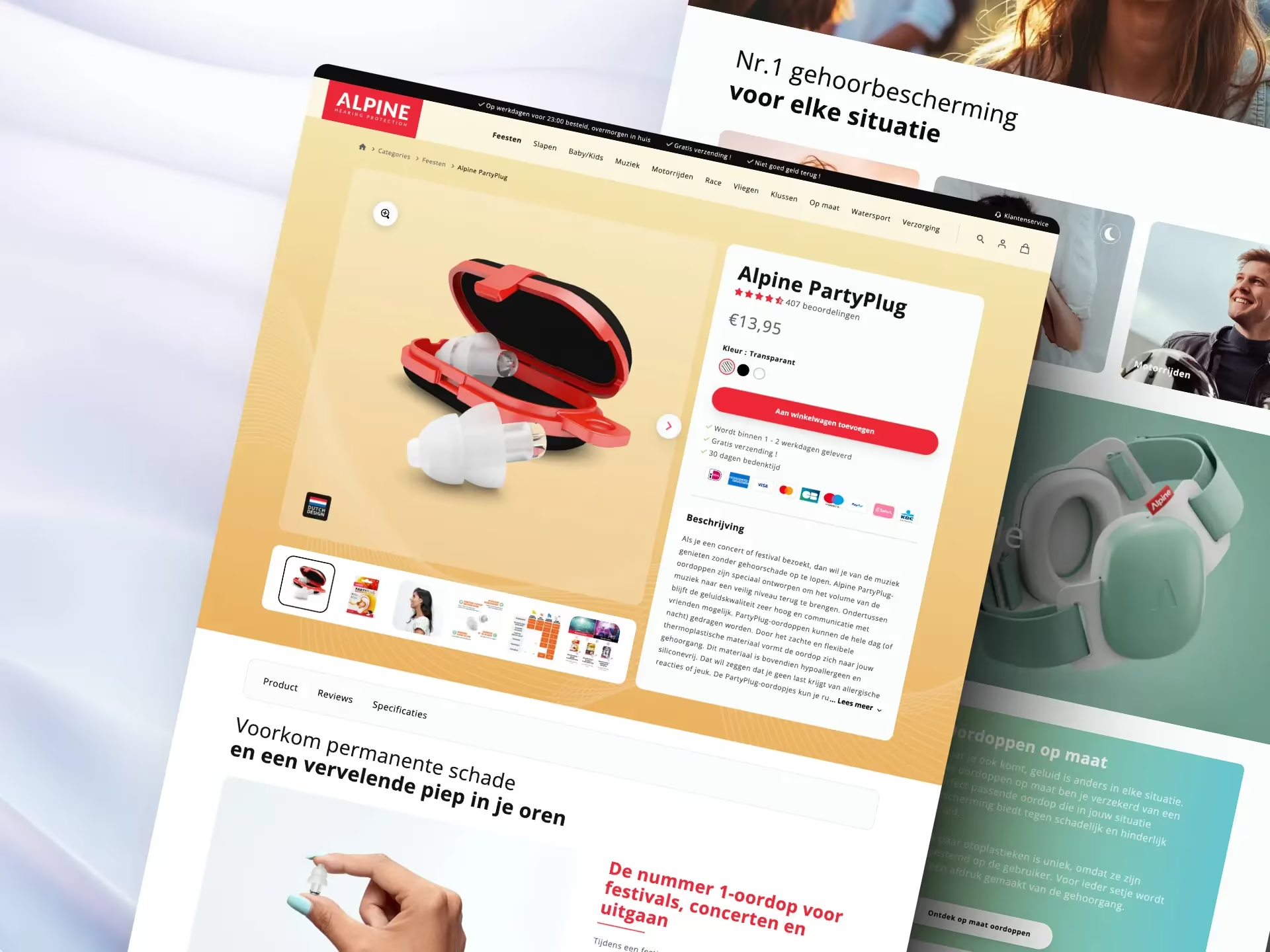

Server-side of client-side variant build

Default: server-side via GrowthBook of Statsig met feature flags die aan de edge of server render worden uitgelezen. Voor Shopify Plus leven server-side varianten in Liquid achter een feature flag. Client-side via VWO of Convert is gereserveerd voor headline- of copy-tests op low-stakes oppervlakken waar flicker-risico acceptabel is. Elke test ship met GA4 variant-exposure custom dimensions bedraad vóór live-gang.

- 04

Test uitvoeren met strikte no-peek monitoring

Zodra een test live staat zijn alleen senior consultants bezig met verificatie dat variant-exposure correct wordt verzameld. Geen statistische reads, geen tussentijdse screenshots naar de klant, geen gluren. Tenzij sequential testing met alpha spending in het testplan was afgesproken, wachten we de berekende steekproef af voor enige conclusie wordt getrokken.

- 05

Winnaar-PR + post-launch monitoring

Als de berekende steekproef is bereikt en het resultaat significant is op de geplande drempel, leveren we een eenpagina test-resultaat PDF met volledige statistische analyse (lift %, betrouwbaarheidsinterval, segment-niveau reads). De winnende variant ship als Liquid of React PR in je productie-repo. Verliezende varianten worden gearchiveerd in de hypothesis library met onderbouwing, zodat hetzelfde idee niet blind opnieuw wordt geprobeerd.

Hypothesis library,power calc, geen gluren.

Onze testprogrammas draaien op een hypothesis library gescoord op impact-to-effort, steekproef en looptijd vooraf berekend in Optimizely of VWO, server-side variant-builds waar mogelijk, en een strikte no-peek regel tot het geplande bezoekersaantal bereikt is. Winnaars ship als Liquid of React PR in je productie-repo, niet als doorlopende VWO overlay die licentiekosten blijft kosten.

Als je een a/b test laat draaien koop je statistisch bewijs dat de ene variant beter presteert dan de andere op een specifieke metric, in een specifiek segment, met een specifieke foutmarge. Niet een VWO-screenshot waarop variant B op dag drie 12% voor staat. De discipline lijkt meer op het ontwerpen van een klinische trial dan op marketing-experimenten doen.

Steekproef versus doorlooptijd

Steekproef is het bezoekersaantal per variant dat je nodig hebt om een gegeven effect te detecteren op 95% betrouwbaarheid en 80% power. Doorlooptijd is het kalendervenster dat dat aantal vraagt gegeven je verkeer. Je hebt beide nodig. Een minimum van 2 weken bestaat om een volledige business-cyclus te dekken, maar als je steekproef niet in 2 weken is gehaald draai je door. Op precies dag 14 stoppen ongeacht steekproef is een van de meest gemaakte fouten.

Server-side versus client-side testen

Server-side varianten renderen de variant-HTML voordat de pagina de browser bereikt. Geen flicker, geen SEO-risico, Googlebot ziet een stabiele pagina. Client-side tools als VWO en Optimizely Web herschrijven de DOM na eerste paint, waardoor zichtbare flicker ontstaat en variant-inhoud wordt verborgen voor crawlers. Voor alles boven de vouw of voor alles dat indexeerbare inhoud raakt wint server-side.

Frequentist versus multi-armed bandit

Frequentist ab testen (de default) is het juiste gereedschap als je een heldere winst of verlies wilt met gekalibreerde false-positive rates. Multi-armed bandit allocatie is het juiste gereedschap voor doorlopende CRO op oppervlakken waar exploratiekosten hoog zijn en je wilt dat verkeer langzaam naar de winnaar verschuift terwijl bewijs accumuleert. We zetten bandits in voor headline-rotatie en productaanbevelingen, niet voor high-stakes redesign-tests.

Segment-niveau reads

Een vlak overall ab test resultaat verbergt vaak een sterk positief effect in één segment (mobiel, terugkerende bezoekers, paid traffic) dat een negatief effect in een ander segment opheft. We registreren de segment-cuts vooraf in het testplan zodat segment-reads bevestigend zijn, niet achteraf p-hacked. Veelvoorkomende cuts: device, traffic source, nieuw versus terugkerend, geo, klant-cohort.

Winrate als eerlijkheid-signaal

Branchegemiddelde ab test winrate is ruwweg 1 op 8 (rond 13%). Alles materieel hoger gerapporteerd door een bureau is een vlag: gluren, p-hacking, gedeeltelijke winsten als winst rapporteren, of minuscule wijzigingen testen die nooit kunnen verliezen. Onze gerapporteerde winrate zit in de 12-18% band afhankelijk van klant-maturiteit, en dat behandelen we als een feature, geen bug.

Multivariate testen in de praktijk

Multivariate testen (meerdere elementen tegelijk testen) vraagt ruwweg N keer de steekproef van een ab test voor N variant-combinaties. Op de meeste ecommerce sites heb je dat verkeer simpelweg niet. We defaulten naar sequentiele ab tests en draaien multivariate alleen als het oppervlak een homepage is met miljoenen bezoekers per maand en het design-team interactie-effecten nodig heeft.

.svg?dpl=dpl_CWQqtYRxoJHqsNZT6bRHrFxDdrec)

.svg?dpl=dpl_CWQqtYRxoJHqsNZT6bRHrFxDdrec)

.svg?dpl=dpl_CWQqtYRxoJHqsNZT6bRHrFxDdrec)

.svg?dpl=dpl_CWQqtYRxoJHqsNZT6bRHrFxDdrec)

Waarom LASEO vs alternatieven

A/B testing eerlijk vergeleken

Generalistische CRO bureaus, VWO-only setups en in-house experimentatie-teams hebben allemaal legitieme use cases. Hier zit LASEO.

Gluurt vroeg, roept winnaars op 50 bezoekers

- Test start, resultaten dagelijks bekeken, winnaar afgeroepen op dag drie als het dashboard op 200 bezoekers per variant op groen springt.

- Wekelijkse tussentijdse screenshots naar de klant. Tests vroeg gestopt als resultaten er gunstig uitzien. False positive rate ruim boven de nominale 5%.

- Alles client-side gebouwd in VWO of Optimizely Web. Zichtbare flicker bij eerste paint. Variant-HTML verborgen voor Googlebot, SEO-risico op indexeerbare content.

- 70 tot 90% gerapporteerde winrate, gehaald via gluren, p-hacking, gedeeltelijke winsten als winst tellen, en minuscule wijzigingen testen die nooit kunnen verliezen.

- Winnende variant onbeperkt actief in VWO. Klant betaalt licentiekosten op varianten die gewoon de default zouden moeten zijn. Toolafhankelijkheid groeit over tijd.

- Winsten onthouden, verliezen stilletjes vergeten. Dezelfde hypothese twee jaar later opnieuw getest door een nieuwe account manager die niet wist dat het eerder faalde.

Vooraf geregistreerd, volledig powered, niet gluren

- Steekproef vooraf berekend in Optimizely of VWO op 95% betrouwbaarheid en 80% power. Test draait tot het berekende bezoekersaantal is bereikt. Geen uitzonderingen buiten vooraf afgesproken sequentiele plannen.

- Nul gluren. Alleen interne verificatie dat variant-exposure correct verzamelt. Reads gebeuren op de geplande steekproef, niet eerder.

- Server-side default via GrowthBook, Statsig of custom feature flags. Liquid voor Shopify Plus, React voor headless. Client-side gereserveerd voor low-stakes copy-tests op niet-indexeerbare oppervlakken.

- 12 tot 18% winrate eerlijk gerapporteerd. Branchegemiddelde is ongeveer 1 op 8 en dat behandelen we als benchmark, geen doel om met statistische trucs te overtreffen.

- Winnende variant ship als Liquid of React PR in je productie-repo. Feature flag wordt verwijderd. Variant wordt de default. Geen licentiekosten op permanente winnaars.

- Gedeelde Notion hypothesis library logt elke test, win of verlies, met testplan, resultaat-PDF en onderbouwing. Doorzoekbaar over de volledige klanthistorie. Verliezers blijven gearchiveerd.

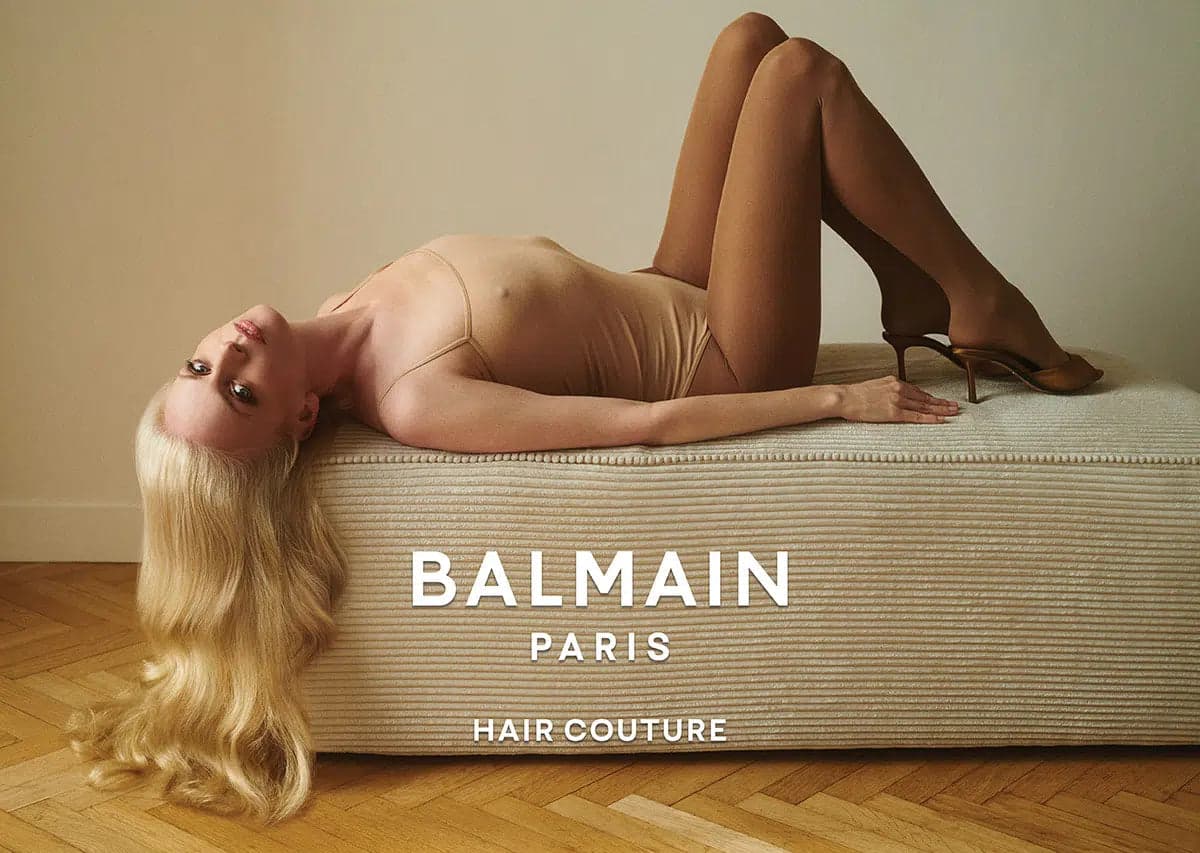

A/B testing engagements op schaal

Testprogrammas die de retainer vele malen terugverdienden

Wat onze testing klanten zeggen

A/B testen in hun eigen woorden

Ons vorige bureau had een winrate van 78%. LASEO zit op 14%. Klinkt slechter tot je beseft dat de vorige winsten nooit in de omzet opdoken. Die van LASEO wel. Vorig kwartaal lifte de nieuwe checkout-variant onze completed orders met 6,2% met een 95% betrouwbaarheidsinterval van 3,1 tot 9,3%, en de omzetstijging hield aan in de maand erna.

Zij waren het eerste bureau dat weigerde te gluren toen onze COO om een tussentijdse screenshot vroeg. We hebben de nieuwe pricing pagina 28 dagen getest, kregen een 4,8% lift op trial starts met een 95% CI van 1,9 tot 7,7%, en het resultaat hield stand toen we naar 100% rolden. Dat soort discipline is zeldzaam.

We zijn met LASEO overgestapt van client-side VWO naar server-side GrowthBook. Flicker op de homepage-hero is weg, onze Core Web Vitals LCP daalde van 2,8s naar 1,9s, en hetzelfde a/b programma is nu indexeerbaar. De herontworpen categoriepagina-variant won met 11,3% lift en een CI van 7,2 tot 15,4% over 6 weken.

Ons vorige bureau had een winrate van 78%. LASEO zit op 14%. Klinkt slechter tot je beseft dat de vorige winsten nooit in de omzet opdoken. Die van LASEO wel. Vorig kwartaal lifte de nieuwe checkout-variant onze completed orders met 6,2% met een 95% betrouwbaarheidsinterval van 3,1 tot 9,3%, en de omzetstijging hield aan in de maand erna.

Zij waren het eerste bureau dat weigerde te gluren toen onze COO om een tussentijdse screenshot vroeg. We hebben de nieuwe pricing pagina 28 dagen getest, kregen een 4,8% lift op trial starts met een 95% CI van 1,9 tot 7,7%, en het resultaat hield stand toen we naar 100% rolden. Dat soort discipline is zeldzaam.

We zijn met LASEO overgestapt van client-side VWO naar server-side GrowthBook. Flicker op de homepage-hero is weg, onze Core Web Vitals LCP daalde van 2,8s naar 1,9s, en hetzelfde a/b programma is nu indexeerbaar. De herontworpen categoriepagina-variant won met 11,3% lift en een CI van 7,2 tot 15,4% over 6 weken.

Eerlijke antwoorden over a/b testing

Wat kopers daadwerkelijk vragen voordat ze een ab testing programma laten starten.

Een a/b test moet draaien tot de vooraf berekende steekproef is bereikt, met een absoluut minimum van twee weken plus één volledige business-cyclus. Twee weken dekt wekelijkse variatie in verkeer en gedrag, en de business-cyclus dekt maandelijkse variatie (loondag, factuurcycli, weekend versus doordeweekse patronen). Als je verkeer laag is en de calculator zegt dat je 6 weken nodig hebt om de steekproef te halen, draai je 6 weken. Op precies dag 14 stoppen ongeacht steekproefgrootte is een van de meest voorkomende redenen waarom CRO-winsten niet beklijven: de test was te weinig powered en de schijnbare lift was statistische ruis.

Testplan-review

Breng een a/b testnaar een senior consultant.

30 minuten met een LASEO senior consultant. Stuur je laatste drie testplannen, je huidige dashboard, of een screenshot van een test waar je onzeker over bent. We vertellen je of de steekproef, segment-cuts en statistische methode standhouden.